ねらい

映像に音楽を加える場合、複数の方法を使っておりますが、MonogokoroのメインはMAXで作製した自動作曲プログラムを使います。すでに何度も登場しておりますが、直近では 2025.11.07のblog 「プロセス絵画2 動的抽象化」の最初の2つの映像の曲が、自動作曲によるものです。この特徴は大きく2つあります。一つは、周囲環境の状態を反映していることです。周囲環境の状態は、前のフレームと今のフレームとの差から求める複雑さパラメータを抽出することで、それが主にボリュームと音の高さのレンジに反映されます。もう一つはリアルタイムに音楽を生成していることです。このためカメラの前で手や体を動かすと、その映像から同期して音楽を生成したり、走行映像を映せば、運転と同期して音楽が生成できます。

一方音を映像に付ける場合は、録音された音源の中からイメージと合うのを探し、多少加工して音を調整し、それを映像のタイミングをタイムラインで合わせて鳴らします。例えば直近では2025.10.24のblog「発振現象の応用2」の2つ目の映像(生物が左から右へ移動する映像)の音は、「炎の音」を再生して生物が進む音を作っています。地中から上に上がってくる時は、「炎の音1」をオン、「炎の音2」をオフ、右に移動する場合は、「炎の音1」をオフし、「炎の音2」をオンしています。このように鳴らすタイミングのコントロールを行っています。

音の動画に対する入れ方は、自動作曲で音楽を作る場合と比べて2つの点で違いを感じております。一つは、音は何かと何かがぶつかる、こすれる等の際に生じたり、粒子がボツボツと独立して衝突することで生じたり、広いところから狭い所に急に移動することで生じたりします。しかし、映像に音を付ける場合、映像の場面からではなく、イメージする音を音源から探し加工して使います。確かに音源自体は録音した音なので、物理現象を反映しています。しかし、映像の中の振る舞いを反映して作られているわけではありません。自動作曲の場合は、複雑さパラメータという周囲環境を表すデータを抽出して作製するので、映像を反映しています。もう一つは、音は映像を作ってから、タイムライン上でタイミングを合わせて映像と同期させます。違う映像になれば、別のタイミングに合わせ直す必要があります。一方自動作曲では、入ってきたデータを音に次々と変換していくので、リアルタイムであり、常に映像と同期します。場面が変わったからといって調整する必要はありません。

そこで音も、映像を基にタイミングを合わせ、リアルタイムで同期することができるのではないかと思っておりました。

最後に映像から音を生成できるようになった場合の別のメリットを考察しておきます。離れているものを感覚的に捉える感覚拡張の方法になる可能性があると思っています。私はこれまで複数の電波センサーを試作してきました。例えば特開2013-171326「入力装置」、特開2015-22699 「車両周囲環境報知システム」、特開2017-53651 「変形検出センサ、入力装置」等です。これらの出力はアナログ信号です。アナログ信号の場合、それを振動スピーカーにつないだり、ハプティック振動子につなぐことで、触覚として体験することができます。そうすると、遠くにあるものや、近くの非接触検出の結果を手や背中で感じるといった体験ができます。興味深いことに、検出した信号からモノの凸凹感といったようなニュアンスを感じれる場合が多いです。そうした体験を思い出しました。現在ミリ波レーダやレーザレーダが発達し、周囲環境に何があるかを測位して映像化できます。この障害物をポテンシャルとして表すと、パソコン上にそれに向かって人工生命を動かしたり、粒子を放出したりすることで、障害物であるポテンシャルと相互作用させることができます。つまり衝突させたり、狭い場所を通したりできます。これの原型は、2025.09.04のblog「ポテンシャルフィールドを含めた・・・」や2025.10.26「フィジカル・インテリジェンス」で記載してうます。特にポテンシャルと線状のポイントとの関係がそれに当たります。こうしたポテンシャルへの衝突や曲がり、狭い間への集中といった出来事が、電波センサーを使って放射し、反射波をセンシングする代わりになるのではないかと考えました。つまり環境を測定し、それをポテンシャルとして表示すると、パソコン上で粒子を当てる計算によって、どういった障害物であるかを感覚として知覚できるようになるのでは、ということです。ポテンシャルに粒子が当たるのを音化する、あるいは触覚化することになります。できるだけ、ザラザラ感や、凸凹感といった質感が分かるようにすることが重要です。映像から音や触覚に変換する技術は、周囲環境を感覚化するのに役立つ、のではないかと思っています。

今回述べるのは、この音のリアルタイム生成の構想の最初期です。細かい説明は固まってからにして、大まかなイメージを伝えたいと思います。以下で検討した2つの例を示します。

映像による音生成

筋肉音の生成

初めに紹介するのは、2025.10.17のblog「発振現象の応用1」で扱った筋肉っぽい動きにドックンドックンという音を合わせた例に対して、リアルタイムに音を生成させてみようと思いました。最初に映像をみていただきます。音も注意して聞いていただければと思います。Touchdesignerで作製しました。

映像に同期して音がなっています。これは最初から音データがあるわけではありません。リアルタイムに生成しています。その生成の方法について大まかな説明を致します。

残念ながら全てをパソコンで作製することはできません、可聴周波数が必要だからです。これをアナログシンセサイザーであるDark energy2で作っています。このアナログシンセは電子回路で波形を生成する装置です。シンセサイザーの波形が決まれば、これを録音し、録音したデータを使うことができます。外部から可聴周波数が必要なため全自動ではありません。この波形を筋肉のような形状の変化を反映したデータで変調することで音の信号を生成します。直ぐに思いつくのはミキシングです。アナログシンセサイザーで作製した音を、映像の形状変化を反映す波形と掛け算(ミキシング)する方法です。形状変化を反映するデータをどうして得るのかという問題に複数回答が考えれます。今回は最も簡単な方法であろう、筋肉の映像の特定の部分の運動による色変化を使うことにしました。つまり膨らんだり収縮したりすることで光を当てている関係から色が変わるのです。この色変化を筋肉の変動と捉えます。これはTouchdesignerが形状をTop to CHOPで色の分布に変換でき、これをchop to DATで数値化し、変化の大きいいところだけ選択することができるからです。Toucdesingerを使っていない方には何のことかわからないと思いますが、ようするに形の変化を色で捉える便利な機能が、オペレータの組み合わせでできるのです。それを使ってみました。結果的には、映像が動くタイミングで音を生成することができました。こうした技術を使うと、筋肉の動く周波数を変えても、同期して音が生成できます。シンセサイザーの音も大きく影響します。またミキシング後もTouchdesignerのフィルタのオペレータを使っています。作製した音をパプティック振動子の入力に使うと、ドッドッドッドッという感覚が非常によく伝わり、感覚として提示するのに適している印象を持ちました。

衝突の感覚音生成

上の例は形状変化を常に監視しておき、その変化のタイミングで録音した音を鳴らしても同様なことができます。そこで次はポテンシャル分布に人工生命のポイント表示を衝突させ、その衝突する動きを音に変換して、スピーカーやハプティック振動子で感覚に変換することを行ってみました。今回は、周期的ではなく、ばらばらに衝突してくるので、これを録音の再生で作るのは不向きと思います。それでは作製した映像を見てください。

ポイントがポテンシャルに衝突した際のポツポツ感が出ていると思います。ポイントの多くが衝突すると音も大きくなっています。そして衝突していない時には音はしません。変化するポテンシャルに対して、リアルタイムで音が生成できています。ハプティック振動子を使うと、ポツポツ感が振動に変換されて触感として感じることができます。「ねらい」で書いた電波センサーのイメージでいうと、ポイントの動きが電波に相当し、それが物体にあたる、といったところです。

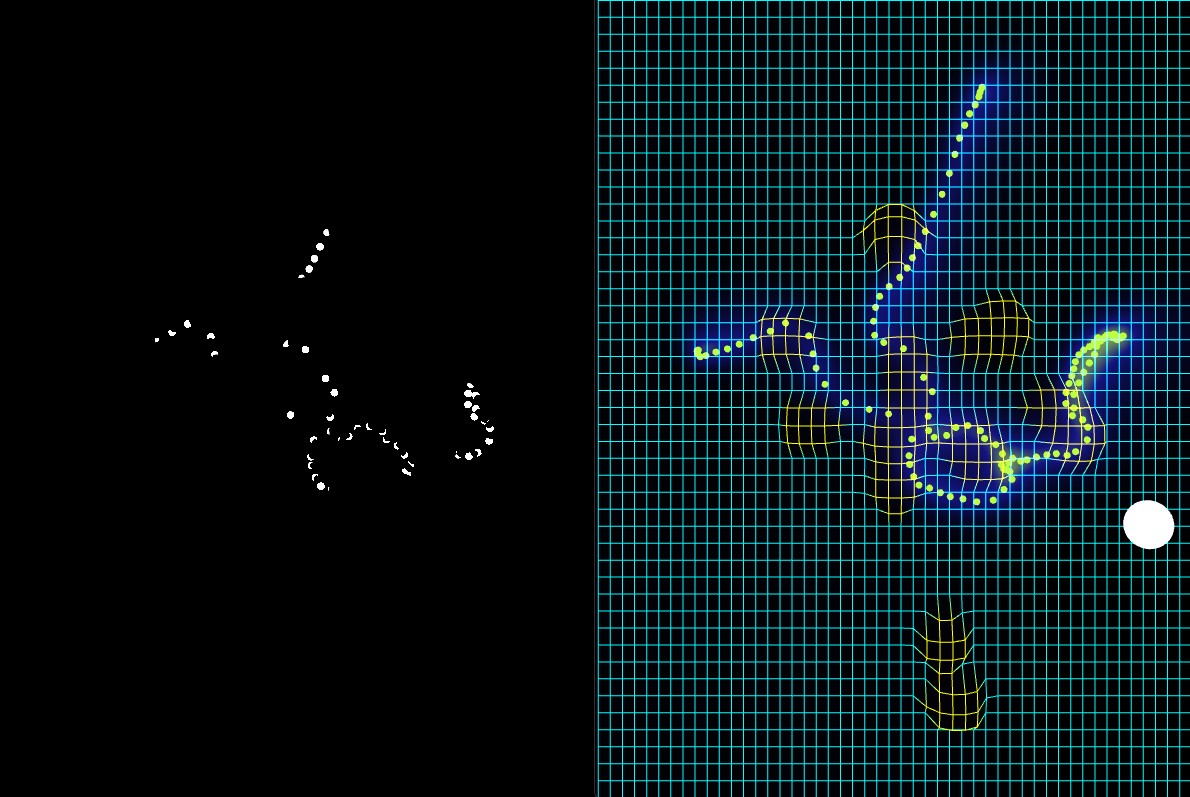

音の生成方法について簡単に説明致します。人工生命のポイント表示した映像と、ポテンシャルの元である、メタボールの形状の分布を表す映像との積を取ります。これはポテンシャル分布と人工生命が衝突した所だけを表示させることに相当します。この画像を示します。右側がポテンシャル分布とポイント表示との重なりを示しています。

この重なりの映像をanalize TOPを使って全ピクセスの平均値に変換します。それをtop to CHOPを使って値を取り出します。この操作は衝突判定によく使う方法です。この値は衝突した数に対応します。これを音に変えていきます。lfo CHOPで1,-1の周期信号を発生させ、これとその値との掛け算を求めます。つまり、1,-1の矩形波を衝突した値でミキシングしたということです。これは音にした時にポツポツ感をだす操作です。この信号を更に、アナログシンセサイザーで発生させた可聴周波数とミキシングします。そうすると聞こえる音に変換されます。フィルタをかけて音の調整はしております。要約すると、「ポテンシャル映像とポイント表示映像との積で、衝突した部分だけの映像を作製し、これを値に変換、その値を矩形波とミキシングして、ポツポツ感の元を作り、それを更に可聴周波数とミキシングして音に変換した」、ということです。電子回路で行うアナログ信号処理をパソコンで行った印象です。音で聞くより、パプティック振動子で触感として体験するほうが適しています。体験いただけないのが残念ですが、ポツポツ感がなかなかいいと思いました。

まとめ

可聴周波数を発生させる信号源が必要ですが(録音しておけば必要はありません)、映像から、リアルタイムに映像と同期した音を作ることができることが分かりました。パプティック振動子や振動スピーカを使うと、質感を持たせた感覚に変換できました。

コメント